Trí tuệ nhân tạo trong tự động hóa

Giải thích các quyết định của AI trong sản xuất (XAI): Chìa khóa Minh bạch, Tuân thủ và Tối ưu hóa trong Tự động hóa Công nghiệp

Trong bối cảnh sản xuất công nghiệp đang chuyển đổi mạnh mẽ nhờ AI và tự động hóa, khả năng Giải thích các quyết định của AI trong sản xuất (XAI) trở nên tối quan trọng. Đây không chỉ là yêu cầu pháp lý then chốt để tuân thủ các quy định quốc tế như EU AI Act, mà còn là nền tảng chiến lược giúp kỹ sư tối ưu hóa hiệu suất sản xuất, xây dựng lòng tin vào hệ thống tự động hóa thông minh và quản lý hiệu quả trách nhiệm pháp lý liên quan.

1. AI trong Sản xuất Công nghiệp

1.1. AI và Tự động hóa chuyển đổi sản xuất: Từ bảo trì dự đoán đến kiểm soát chất lượng tự động hóa

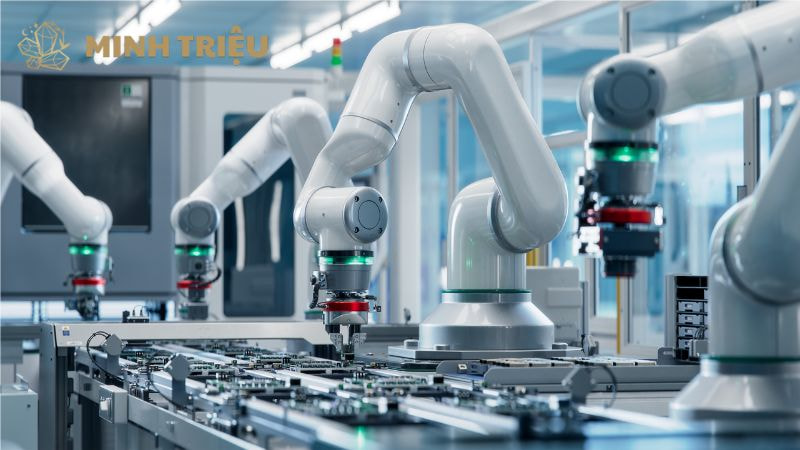

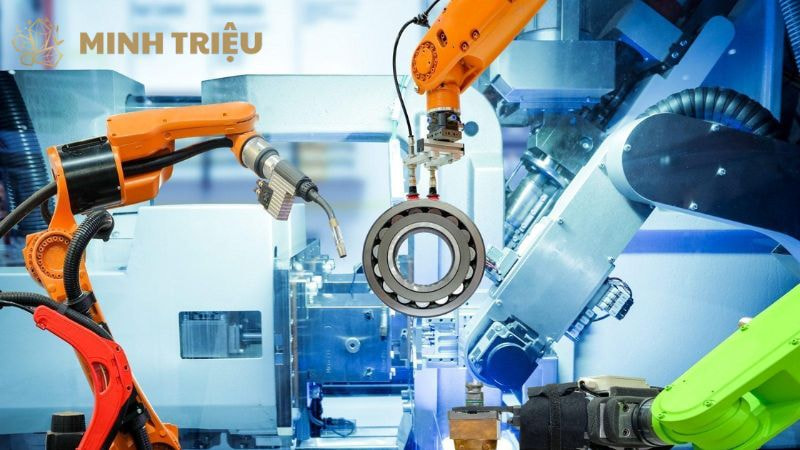

Trí tuệ nhân tạo (AI) đã củng cố vị thế là động lực cốt lõi của Công nghiệp 4.0, đặc biệt trong lĩnh vực sản xuất công nghiệp. Việc tích hợp AI vào các hệ thống tự động hóa đã không chỉ thay đổi cách thức sản xuất mà còn nâng cao chất lượng và hiệu suất vận hành. Các ứng dụng cốt lõi của AI trong sản xuất bao gồm:

- Bảo trì dự đoán (Predictive Maintenance – PdM): Sử dụng AI để phân tích dữ liệu cảm biến IIoT (Industrial Internet of Things) (như rung động, nhiệt độ, áp suất) nhằm dự đoán chính xác thời gian hỏng hóc của máy móc, cho phép bảo trì trước khi sự cố xảy ra.

- Kiểm soát chất lượng tự động hóa (Automated Quality Control – AQC): AI thị giác máy tính (Computer Vision) được triển khai để kiểm tra sản phẩm với tốc độ và độ chính xác vượt trội so với con người.

- Tối ưu hóa chuỗi cung ứng và lập lịch trình sản xuất: AI phân tích các ràng buộc phức tạp (nguồn lực, thời gian chờ, tồn kho) để đưa ra các quyết định tối ưu hóa tự động hóa.

Tuy nhiên, khi AI đưa ra các quyết định có tác động chiến lược hoặc an toàn, việc chấp nhận kết quả không cần giải thích là không thể. Nhu cầu về Giải thích các quyết định của AI trong sản xuất đã trở thành yêu cầu cấp thiết.

1.2. Vấn đề “Hộp đen” (Black Box): Sự mâu thuẫn giữa hiệu suất cao và tính minh bạch thấp

AI hiện đại, đặc biệt là các mô hình Học sâu (Deep Learning) như Mạng nơ-ron tích chập (CNN) được dùng trong kiểm soát chất lượng hình ảnh hay Mạng nơ-ron hồi quy (RNN) dùng trong phân tích chuỗi thời gian, là những “Hộp đen” (Black Box). Mặc dù các mô hình Học sâu này đạt độ chính xác dự đoán cực cao, chúng lại không cung cấp được lý do logic, dễ hiểu cho một quyết định cụ thể. Ví dụ: AI có thể dự đoán một động cơ sẽ hỏng hóc với độ chính xác 98%, nhưng không thể nói rõ tại sao nó lại đưa ra dự đoán đó, hay đặc điểm nào của dữ liệu cảm biến là quan trọng nhất. Sự thiếu minh bạch này tạo ra:

- Rủi ro vận hành: Kỹ sư không thể xác nhận kết quả dự đoán của AI bằng kinh nghiệm chuyên môn vật lý của họ.

- Rủi ro pháp lý: Không có bằng chứng giải thích để bảo vệ doanh nghiệp khi AI đưa ra quyết định sai lầm gây thiệt hại.

1.3. Khái niệm Giải thích các quyết định của AI trong sản xuất (XAI): Tầm quan trọng đối với Trách nhiệm Pháp lý (Liability), Đạo đức AI và Vận hành Công nghiệp

Giải thích các quyết định của AI trong sản xuất (Explainable AI – XAI) là một tập hợp các kỹ thuật và phương pháp nhằm biến mô hình AI phức tạp thành mô hình có thể hiểu, giải thích và đáng tin cậy. Tầm quan trọng của XAI trong sản xuất công nghiệp được thể hiện qua ba trụ cột:

- Trách nhiệm Pháp lý và Tuân thủ: XAI cung cấp bằng chứng pháp lý về sự tuân thủ tiêu chuẩn an toàn và chất lượng. Khi xảy ra sự cố, XAI giúp phân định trách nhiệm pháp lý giữa nhà sản xuất phần mềm, nhà sản xuất phần cứng và người vận hành.

- Đạo đức AI và Tính Công bằng: XAI là công cụ kiểm tra thiên vị thuật toán (Algorithmic Bias), đảm bảo AI đưa ra các quyết định công bằng và không phân biệt đối xử (ví dụ: trong phân bổ công việc hay đánh giá hiệu suất).

- Vận hành và Tối ưu hóa: XAI giúp kỹ sư hiểu được lỗi AI, từ đó cải thiện chất lượng dữ liệu đào tạo, tinh chỉnh mô hình và tối ưu hóa quy trình sản xuất dựa trên giải thích của AI.

2. Các Yêu cầu và Quy định Pháp lý thúc đẩy XAI

Nhu cầu về Giải thích các quyết định của AI trong sản xuất không chỉ là mong muốn kỹ thuật mà đã trở thành yêu cầu pháp lý nghiêm ngặt ở nhiều khu vực, đặc biệt là châu Âu.

2.1. EU AI Act và AI Rủi ro Cao trong Sản xuất

EU AI Act là khung quy định toàn diện nhất về AI, áp dụng cách tiếp cận dựa trên rủi ro. Nhiều ứng dụng AI trong sản xuất công nghiệp được phân loại là AI Rủi ro Cao vì chúng liên quan đến an toàn và sức khỏe của con người hoặc có tác động đáng kể đến các quyền cơ bản.

- Quy định bắt buộc về Minh bạch và khả năng Giải thích: Đối với AI Rủi ro Cao, Đạo luật yêu cầu các nhà cung cấp phải thiết lập các hệ thống cho phép Minh bạch về chức năng và Giải thích các quyết định của AI trong sản xuất. Điều này bao gồm khả năng người dùng hiểu được dữ liệu đầu vào, đầu ra và cách thức AI đi đến quyết định đó.

- Yêu cầu ghi nhật ký tự động hóa chi tiết (Logging): Hệ thống AI phải được thiết kế để ghi nhật ký tự động hóa các sự kiện quan trọng và các quyết định được thực hiện trong suốt vòng đời của nó. Bằng chứng ghi nhật ký này là tài liệu bắt buộc để thực hiện Đánh giá sự phù hợp (Conformity Assessment) và giải quyết các vấn đề pháp lý sau này.

Việc tuân thủ EU AI Act đòi hỏi các nhà sản xuất phải tích hợp XAI ngay từ bước thiết kế hệ thống AI.

2.2. Quy định về Trách nhiệm Sản phẩm (Product Liability)

Luật Trách nhiệm Sản phẩm truyền thống được xây dựng để xử lý các lỗi vật lý hoặc thiết kế cố định. Tuy nhiên, các sản phẩm AI là “sống” vì chúng học hỏi và thay đổi hành vi theo thời gian.

- Nhu cầu Giải thích để phân định trách nhiệm pháp lý: Khi một robot tự động hóa không được lập trình sai ban đầu nhưng lại gây ra lỗi sau khi học dữ liệu mới, XAI phải cung cấp bằng chứng cho thấy lỗi đó là do dữ liệu đầu vào sai (lỗi của người vận hành) hay do thiết kế thuật toán (trách nhiệm của nhà phát triển AI).

- Giả định thuận lợi cho người bị thiệt hại: Các đề xuất pháp lý mới đang cố gắng tạo ra một “quyền được giải thích” cho người bị thiệt hại. Giải thích các quyết định của AI trong sản xuất sẽ là biện pháp bảo vệ cần thiết để nhà sản xuất tránh được trách nhiệm vô căn cứ.

2.3. Đạo đức AI và Tính công bằng: Giải thích các quyết định của AI trong sản xuất để kiểm tra Thiên vị

Trong sản xuất, AI được sử dụng để đưa ra quyết định về phân bổ nhiệm vụ, đánh giá hiệu suất lao động, hoặc thậm chí là tối ưu hóa chuỗi cung ứng. Nếu AI bị thiên vị (Algorithmic Bias), nó có thể dẫn đến quyết định không công bằng hoặc phân biệt đối xử. Giải thích các quyết định của AI trong sản xuất cung cấp các công cụ kiểm tra minh bạch để:

- Xác định nguồn gốc thiên vị: Giải thích cho thấy liệu AI có đang dựa vào các đặc điểm không liên quan và có khả năng phân biệt đối xử (như tuổi tác hay vùng miền) để đưa ra quyết định hay không.

- Chứng minh tính công bằng: Các nhà sản xuất có thể sử dụng XAI để chứng minh với cơ quan quy định và người lao động rằng các mô hình tự động hóa của họ hoạt động một cách công bằng và đạo đức.

3. Các Phương pháp và Kỹ thuật Giải thích các quyết định của AI trong sản xuất (XAI)

Để thực hiện Giải thích các quyết định của AI trong sản xuất, các chuyên gia AI sử dụng nhiều kỹ thuật khác nhau, được chia thành hai nhóm chính.

3.1. Phương pháp Giải thích Trước (Ante-hoc Explainability)

Phương pháp này sử dụng các mô hình AI vốn dĩ đã có tính minh bạch cao, nơi kết quả dự đoán có thể được truy ngược ngay lập tức thông qua một chuỗi logic rõ ràng.

- Mô hình Minh bạch (Transparent Models): Bao gồm cây quyết định (Decision Trees), hồi quy tuyến tính (Linear Regression) hoặc mô hình Bayes đơn giản.

- Ưu điểm: Độ chính xác giải thích tuyệt đối, dễ hiểu đối với kỹ sư vận hành.

- Nhược điểm: Không phù hợp với các bài toán phức tạp đòi hỏi xử lý dữ liệu phi tuyến tính khổng lồ (ví dụ: kiểm soát chất lượng hình ảnh, phân tích chuỗi thời gian phức tạp). Trong sản xuất công nghiệp hiện đại, phương pháp này thường chỉ được dùng cho các ứng dụng AI cấp độ thấp hoặc trung bình.

3.2. Phương pháp Giải thích Sau (Post-hoc Explainability)

Đây là phương pháp phổ biến nhất để xử lý các mô hình “Hộp đen” (Black Box Models) như Học sâu. Kỹ thuật Post-hoc áp dụng một mô hình giải thích độc lập lên mô hình AI đã được huấn luyện để hiểu hành vi của nó.

- LIME (Local Interpretable Model-agnostic Explanations):

- Cơ chế: Giải thích tại chỗ (Local). LIME tạo ra một mô hình đơn giản (ví dụ: mô hình hồi quy) xung quanh một quyết định cụ thể của AI. Nó làm điều này bằng cách tạo ra các điểm dữ liệu giả, gây nhiễu cho đầu vào ban đầu và xem AI thay đổi quyết định như thế nào.

- Ứng dụng trong sản xuất: Giải thích tại sao một sản phẩm cụ thể bị từ chối (quyết định cục bộ), không giải thích hành vi toàn cục của AI.

- SHAP (SHapley Additive exPlanations):

- Cơ chế: Giải thích toàn cục (Global) và tại chỗ dựa trên Lý thuyết Trò chơi (Game Theory). SHAP định lượng sự đóng góp của từng đặc điểm (feature) đầu vào vào quyết định cuối cùng của AI. Giá trị SHAP cho biết tác động trung bình mà một đặc điểm mang lại khi AI đưa ra quyết định.

- Ứng dụng trong sản xuất: Cung cấp cái nhìn toàn cục về tầm quan trọng của các yếu tố đầu vào (rung động, nhiệt độ, độ ẩm) đối với dự đoán hỏng hóc chung của máy móc.

3.3. Visualization Giải thích

Để Giải thích các quyết định của AI trong sản xuất cho con người, kết quả XAI thường được chuyển thành dạng hình ảnh:

- Bản đồ nhiệt (Heatmap) cho kiểm soát chất lượng hình ảnh (ví dụ: Grad-CAM): Hiển thị chính xác khu vực pixel mà AI đang tập trung vào khi đưa ra quyết định (ví dụ: nơi vết nứt nằm trên bề mặt sản phẩm).

- Biểu đồ tầm quan trọng của đặc điểm (Feature Importance Plot): Thể hiện tác động tương đối của các đặc điểm đầu vào mà AI đã sử dụng để đưa ra dự đoán bảo trì.

4. Ứng dụng Giải thích các quyết định của AI trong sản xuất theo Chức năng

Khả năng Giải thích các quyết định của AI trong sản xuất mang lại giá trị vận hành thực tế trong nhiều lĩnh vực công nghiệp.

4.1. XAI trong Bảo trì Dự đoán (Predictive Maintenance – PdM)

Trong PdM, AI phải đưa ra quyết định bảo trì tốn kém và chiến lược. XAI chuyển quyết định dự đoán trừu tượng thành bằng chứng kỹ thuật:

- AI quyết định rằng một máy bơm cần được thay thế trong 48 giờ.

- XAI sử dụng SHAP để giải thích rằng quyết định này bị thúc đẩy chủ yếu bởi sự gia tăng đột ngột của biên độ rung động tại tần số trong 6 giờ gần nhất, kết hợp với sự tăng lên của nhiệt độ dầu bôi trơn.

- Lợi ích: Thay vì chỉ chấp nhận dự đoán mù quáng, kỹ sư có thể truy cập dữ liệu rung động và nhiệt độ thực tế để xác nhận nguồn gốc vật lý của dự đoán, tối ưu hóa nguồn lực và giảm thiểu rủi ro bảo trì không cần thiết.

4.2. XAI trong Kiểm soát Chất lượng Tự động hóa (Automated Quality Control – AQC)

Khi AI thị giác máy tính từ chối một sản phẩm (loại bỏ khỏi dây chuyền sản xuất), cần phải giải thích để đảm bảo tính nhất quán và tuân thủ kiểm soát chất lượng.

- AI quyết định từ chối một tấm kim loại.

- XAI tạo ra một bản đồ nhiệt (Grad-CAM) hiển thị chính xác khu vực mà AI tập trung vào – ví dụ, một đốm sáng nhỏ ở góc dưới bên trái của tấm kim loại.

- Lợi ích: Giảm thiểu sai sót nhận dạng (False Rejects), giúp kỹ sư kiểm tra chất lượng hiểu được tiêu chuẩn của AI, và quan trọng hơn, cung cấp bằng chứng pháp lý về lỗi sản phẩm nếu có tranh chấp với nhà cung cấp nguyên liệu.

4.3. XAI trong Tối ưu hóa Quy trình Sản xuất và Lập lịch trình

Hệ thống AI tự động hóa trong lập lịch trình có thể thay đổi kế hoạch sản xuất hàng ngày.

- AI quyết định hoãn sản xuất một lô hàng và ưu tiên lô hàng khác.

- XAI giải thích quyết định này bị tác động chủ yếu bởi ba yếu tố: nguồn cung nguyên vật liệu bị thiếu hụt trong 1 ngày (đặc điểm quan trọng nhất), thời gian chết dự đoán của máy móc trong 4 giờ tới, và áp lực thời gian giao hàng cho khách hàng chiến lược.

- Lợi ích: Nhà quản lý sản xuất có thể nhanh chóng xác định các điểm tắc nghẽn và phản ứng bằng cách tìm nguồn cung thay thế hoặc ủy quyền bảo trì khẩn cấp.

5. Thách thức và Cách khắc phục khi Giải thích các quyết định của AI trong sản xuất

Mặc dù XAI là cần thiết, việc triển khai nó trong môi trường sản xuất thời gian thực đi kèm với nhiều thách thức.

5.1. Thách thức về Tính Ổn định (Fidelity) và Khả năng Giải thích (Trade-off)

Có một sự đánh đổi cố hữu: Mô hình AI càng phức tạp (Học sâu) thì hiệu suất dự đoán càng cao, nhưng khả năng giải thích lại càng thấp (chi phí XAI càng lớn). Ngược lại, mô hình đơn giản thì minh bạch nhưng độ chính xác đủ cho các ứng dụng công nghiệp quan trọng.

Khắc phục: Đối với các hệ thống AI Rủi ro Cao, cần phải ưu tiên hiệu suất dự đoán. Sau đó, sử dụng phương pháp Post-hoc Giải thích các quyết định của AI trong sản xuất để cung cấp minh bạch mà không làm giảm độ chính xác của mô hình gốc. Cần có một thỏa hiệp được pháp lý chấp nhận về mức độ minh bạch tối thiểu.

5.2. Thách thức về Dữ liệu và Ngữ cảnh Công nghiệp

Kết quả của XAI (ví dụ: giá trị SHAP hoặc tầm quan trọng của đặc điểm) thường là số liệu thống kê hoặc toán học thuần túy, không có ý nghĩa trực tiếp đối với kỹ sư vận hành thiếu kinh nghiệm về AI.

Khắc phục: Giải thích các quyết định của AI trong sản xuất phải được dịch sang ngôn ngữ kỹ thuật mà người dùng cuối hiểu được. Ví dụ, thay vì nói “Giá trị SHAP của đặc điểm X là 0.7” hệ thống nên nói “Khả năng hỏng hóc tăng 40% do nhiệt độ vòng bi đã vượt ngưỡng cảnh báo trung bình trong 2 giờ qua.” Cần có sự hợp tác chặt chẽ giữa nhà khoa học dữ liệu và kỹ sư chuyên môn công nghiệp để xây dựng các thuật ngữ giải thích có ý nghĩa.

5.3. Thách thức Chi phí và Thời gian Tính toán Thời gian thực

Các kỹ thuật XAI mạnh mẽ như SHAP đòi hỏi thời gian và tài nguyên tính toán đáng kể. Điều này tạo ra một rào cản lớn đối với các ứng dụng AI cần phản ứng trong thời gian thực (ví dụ: hệ thống an toàn tự động hóa).

Các cách khắc phục:

- Phân tầng Giải thích: Chỉ áp dụng các phương pháp XAI phức tạp (như SHAP) cho việc đánh giá ngoại tuyến (offline assessment) hoặc đánh giá định kỳ mô hình.

- Ưu tiên Giải thích nhanh: Sử dụng các phương pháp XAI nhanh hơn (ví dụ: LIME hoặc các kỹ thuật giải thích dựa trên độ dốc) cho các quyết định thời gian thực cần phản ứng nhanh.

- Tích hợp Giải thích vào Mô hình: Triển khai các mô hình AI có khả năng giải thích nội tại (inherently interpretable) ngay từ bước đầu tiên để giảm thiểu gánh nặng tính toán sau này.

6. Kết luận

Giải thích các quyết định của AI trong sản xuất (XAI) là một yếu tố không thể thiếu trong kỷ nguyên AI và tự động hóa công nghiệp. Việc triển khai XAI không chỉ đơn thuần đáp ứng tuân thủ pháp lý – đặc biệt là các quy định nghiêm ngặt đối với AI Rủi ro Cao – mà còn trực tiếp thúc đẩy cải tiến quy trình và tăng hiệu suất bằng cách biến “Hộp đen” thành nguồn tri thức minh bạch. Doanh nghiệp sản xuất cần xây dựng Khung Quản trị AI toàn diện, xác định rõ yêu cầu ngay từ bước đầu tiên của dự án AI, và đào tạo đội ngũ kỹ sư để hiểu và sử dụng kết quả XAI nhằm đảm bảo sự phát triển bền vững và có trách nhiệm của Trí tuệ nhân tạo trong công nghiệp hóa hiện đại.